ที่มาโปรเซสเซอร์ CerebrasSystems - HPCGuru

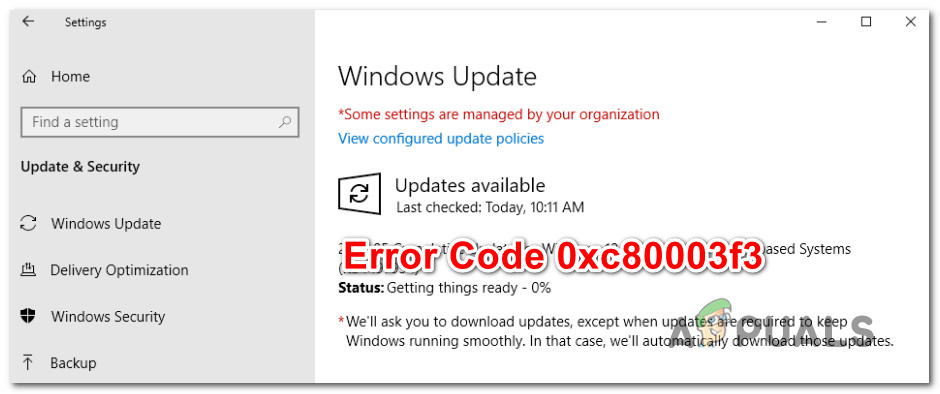

บริษัท แห่งหนึ่งได้จัดการเพื่อสร้างชิปประมวลผลที่ใหญ่ที่สุดเท่าที่เคยมีมาซึ่งเกินกว่าที่ Intel หรือ AMD เคยผลิตมา ด้วยทรานซิสเตอร์ 1.2 ล้านล้านตัวบนเวเฟอร์ซิลิกอนโปรเซสเซอร์จึงเป็นชิปเซมิคอนดักเตอร์ที่ใหญ่ที่สุดเท่าที่เคยมีมา บริษัท ที่อยู่เบื้องหลังโปรเซสเซอร์กำลังวางแผนที่จะอุทิศชิปเพื่อเพิ่มปัญญาประดิษฐ์ (AI)

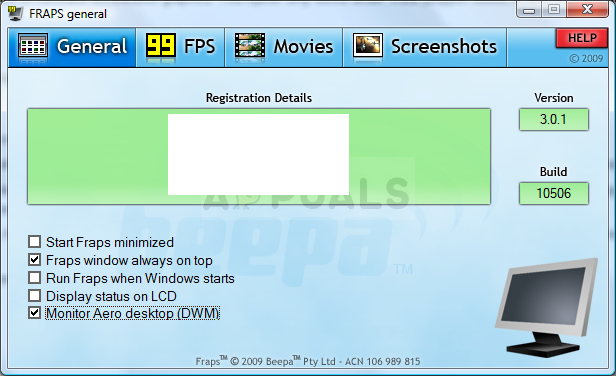

Cerebras Wafer Scale Engine ผลิตโดย บริษัท ปัญญาประดิษฐ์แห่งใหม่ Cerebras Systems เป็นชิปเซมิคอนดักเตอร์ที่ใหญ่ที่สุดเท่าที่เคยมีมา หน่วยประมวลผลกลางหรือซีพียูมีทรานซิสเตอร์ 1.2 ล้านล้านตัวซึ่งเป็นสวิตช์อิเล็กทรอนิกส์พื้นฐานและจำเป็นที่สุดในบรรดาชิปซิลิกอน โปรเซสเซอร์ที่เพิ่งผลิตโดยโปรเซสเซอร์ Advanced Micro Devices มีทรานซิสเตอร์ 32 พันล้านตัว ไม่จำเป็นต้องพูดถึงจำนวนทรานซิสเตอร์บน Cerebras Wafer Scale Engine นั้นสูงเกินกว่าซีพียูและ GPU ระดับท็อปของ AMD และ Intel

Cerebras Wafer Scale Engine เป็นโปรเซสเซอร์ชิปเดี่ยวที่ใหญ่ที่สุดเท่าที่เคยมีมา:

Cerebras WSE เป็นเวเฟอร์ซิลิกอนขนาดมหึมาขนาด 46,225 ตารางมิลลิเมตรที่มีการเพิ่มประสิทธิภาพ AI 400,000 ไม่มีแคชไม่มีโอเวอร์เฮดแกนประมวลผลและหน่วยความจำ SRAM แบบกระจายความเร็วสูง 18 กิกะไบต์ในระดับเดียวและระดับเดียวของหน่วยความจำ ลำดับชั้น ในการเปรียบเทียบ NVIDIA GPU ที่ใหญ่ที่สุดมีขนาด 815 ตารางมิลลิเมตรและบรรจุทรานซิสเตอร์ 21.1 พันล้านตัว คณิตศาสตร์อย่างง่ายจะระบุว่า Cerebras WSE มีขนาดใหญ่กว่า NVIDIA GPU ระดับไฮเอนด์ 56.7 เท่า

วันนี้เป็นวันที่สมบูรณ์แบบในการแชร์ทวีตแรกของเราเนื่องจากเราได้ประกาศชิปที่ใหญ่ที่สุดที่เคยสร้างมาเพื่อเร่งการประมวลผล AI! อ่านข้อมูลทั้งหมดเกี่ยวกับ Cerebras Wafer Scale Engine (WSE) ได้ทาง @WIRED และ @tsimonite https://t.co/ATaBRnxnGD pic.twitter.com/dX0xetyX6X

- Cerebras Systems (@CerebrasSystems) 19 สิงหาคม 2019

แบนด์วิดท์หน่วยความจำของ Cerebras WSE คือ 9 เพตะไบต์ต่อวินาที กล่าวอีกนัยหนึ่งโปรเซสเซอร์ที่ใหญ่ที่สุดในโลกมีหน่วยความจำบนชิปความเร็วสูงมากกว่า 3,000 เท่าและแบนด์วิดท์หน่วยความจำเพิ่มขึ้น 10,000 เท่า คอร์ของโปรเซสเซอร์ถูกเชื่อมโยงเข้าด้วยกันด้วยเครือข่ายการสื่อสารที่เชื่อมต่อด้วยตาข่ายบนชิปทั้งหมด เนื่องจากสถาปัตยกรรมที่เรียบง่ายและขนาดแม่พิมพ์ที่ใหญ่รวมกับแบนด์วิดท์ที่สูงเป็นพิเศษโปรเซสเซอร์จึงสามารถส่งมอบแบนด์วิดท์รวม 100 เพตาบิตต่อวินาที พูดง่ายๆก็คือคอร์จำนวนมากของ Cerebras WSE หน่วยความจำในตัวเครื่องที่มากขึ้นและผ้าแบนด์วิธที่มีความหน่วงต่ำและมีแบนด์วิธสูงทำให้เป็นโปรเซสเซอร์ที่เหมาะอย่างยิ่งในการเร่งงานปัญญาประดิษฐ์

เหตุใด Intel และ AMD จึงไม่สร้างซีพียูและ GPU ขนาดใหญ่ที่ออกแบบตามสั่งเช่นนี้

Intel, AMD และ ผู้ผลิตชิปซิลิกอนอื่น ๆ ส่วนใหญ่ ใช้วิธีการแบบดั้งเดิมที่แตกต่างไปจากเดิมอย่างสิ้นเชิง GPU และซีพียูที่มีประสิทธิภาพที่มีอยู่ทั่วไปเป็นชุดของชิปที่สร้างขึ้นจากซิลิคอนเวเฟอร์ขนาด 12 นิ้วและได้รับการประมวลผลในโรงงานชิปเป็นชุด ในทางกลับกัน Cerebras WSE เป็นชิปตัวเดียวที่เชื่อมต่อกันบนเวเฟอร์เดียว พูดง่ายๆก็คือทรานซิสเตอร์ 1.2 ล้านล้านตัวบนโปรเซสเซอร์ที่ใหญ่ที่สุดทำงานร่วมกันเป็นชิปซิลิกอนขนาดยักษ์เพียงตัวเดียว

มีเหตุผลง่ายๆว่าทำไม บริษัท อย่าง Intel และ AMD จึงไม่ลงทุนในซิลิคอนเวเฟอร์ขนาดใหญ่อย่างไม่น่าเชื่อ เวเฟอร์ซิลิกอนแผ่นเดียวจะมีสิ่งสกปรกเล็กน้อยซึ่งอาจมีผลต่อการเรียงซ้อนและทำให้เกิดความล้มเหลวในที่สุด ผู้ผลิตชิปตระหนักดีถึงสิ่งเดียวกันและสร้างโปรเซสเซอร์ตามนั้น ดังนั้นผลผลิตที่แท้จริงของเวเฟอร์ซิลิกอนในแง่ของชิปซิลิกอนที่ทำงานได้อย่างน่าเชื่อถือจึงค่อนข้างต่ำ กล่าวอีกนัยหนึ่งคือถ้าเวเฟอร์ซิลิกอนมีชิปเพียงตัวเดียวโอกาสที่จะเกิดสิ่งสกปรกและความล้มเหลวนั้นค่อนข้างสูง

Cerebras Wafer Scale Engine (WSE) เป็นชิปตัวเดียวที่มีทรานซิสเตอร์มากกว่า 1.2 ล้านล้านตัว pic.twitter.com/LvyQuBPdSE

- HPC Guru (@HPC_Guru) 19 สิงหาคม 2019

ที่น่าสนใจคือในขณะที่ บริษัท อื่น ๆ ยังไม่คิดหาวิธีแก้ปัญหาที่ใช้งานได้ แต่มีรายงานว่า Cerebras ได้ออกแบบชิปให้ซ้ำซ้อน กล่าวง่ายๆก็คือสิ่งเจือปนเพียงอย่างเดียวจะไม่ปิดใช้งานชิปทั้งหมดแอนดรูเฟลด์แมนผู้ร่วมก่อตั้ง Cerebras Systems และดำรงตำแหน่งซีอีโอ “ Cerebras WSE ได้รับการออกแบบมาจากพื้นฐานสำหรับงาน AI ประกอบด้วยนวัตกรรมพื้นฐานที่พัฒนาความล้ำสมัยด้วยการแก้ปัญหาทางเทคนิคที่มีมานานหลายทศวรรษซึ่งมีขนาดชิปที่ จำกัด เช่นการเชื่อมต่อแบบข้ามเส้นเล็งผลผลิตการส่งกำลังและ บรรจุภัณฑ์ ทุกการตัดสินใจทางสถาปัตยกรรมเกิดขึ้นเพื่อเพิ่มประสิทธิภาพสำหรับงาน AI ผลลัพธ์ที่ได้คือ Cerebras WSE ให้ประสิทธิภาพของโซลูชันที่มีอยู่นับร้อยหรือหลายพันเท่าโดยใช้พลังงานและพื้นที่เพียงเล็กน้อย”

งาน AI จะยังคงต้องการชิปที่ใหญ่ขึ้น:

โปรเซสเซอร์ใหม่สร้างขึ้นเพื่อจัดการงาน AI เป็นหลักเนื่องจากชิปขนาดใหญ่ประมวลผลข้อมูลได้เร็วขึ้นทำให้ได้รับคำตอบในเวลาที่น้อยลง บริษัท เทคโนโลยีส่วนใหญ่อ้างว่าข้อ จำกัด พื้นฐานของ AI ในปัจจุบันคือการฝึกโมเดลใช้เวลานานเกินไป ดังนั้นผู้นำทางเทคโนโลยีบางรายจึงพยายามเพิ่มประสิทธิภาพอัลกอริทึม AI ของตนเพื่อพึ่งพาชุดข้อมูลที่น้อยลง อย่างไรก็ตาม AI ที่ดีใด ๆ จะดีขึ้นอย่างเห็นได้ชัดเมื่อมีชุดข้อมูลขนาดใหญ่ขึ้น การลดเวลาในการฝึกอบรมโดยการเพิ่มขนาด CPU เป็นวิธีหนึ่งในการเพิ่มการประมวลผลและลดเวลาในการฝึกอบรมโดยไม่ส่งผลต่อคุณภาพของ AI ที่เป็นผลลัพธ์

ผ้าการสื่อสารระหว่างโปรเซสเซอร์ที่ติดตั้งบน Cerebras WSE ก็เป็นหนึ่งในชนิดเช่นกัน ความหน่วงแฝงต่ำแบนด์วิดท์สูงตาข่าย 2D เชื่อมโยงคอร์ทั้งหมด 400,000 คอร์บน WSE ด้วยแบนด์วิดท์รวม 100 เพตาบิตต่อวินาที นอกจากนี้คอร์บนโปรเซสเซอร์ยังเป็น Sparse Linear Algebra Cores (SLAC) ซึ่งได้รับการปรับให้เหมาะสมสำหรับไพรมาติกการประมวลผลเครือข่ายประสาทเทียม ทั้งสองด้านทำให้ชิปก้าวไปไกลสำหรับงาน AI ดังนั้นจึงไม่น่าเป็นไปได้ที่นักเล่นเกมจะสามารถซื้อ CPU หรือ GPU ที่ใหญ่และทรงพลังที่สุดสำหรับพีซีของพวกเขาได้

แท็ก เอเอ็มดี intel