Google Voice Search

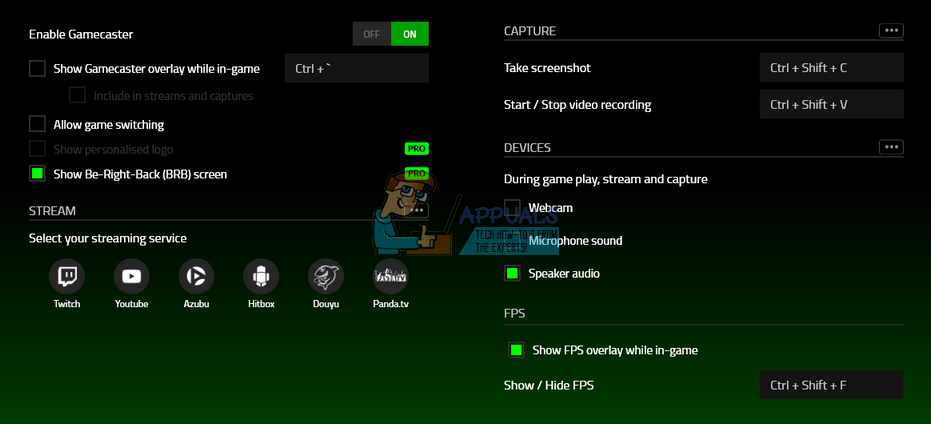

Google เป็นหนึ่งในผู้บุกเบิกการวิจัย AI และมีโครงการมากมายที่จะเปลี่ยนโฉมหน้า AlphaZero จาก Google DeepMind ทีมเป็นความก้าวหน้าในการวิจัย AI เนื่องจากความสามารถของโปรแกรมในการเรียนรู้เกมที่ซับซ้อนด้วยตัวเอง (โดยไม่ต้องมีการฝึกอบรมและการแทรกแซงจากมนุษย์) Google ยังทำงานได้อย่างยอดเยี่ยมใน โปรแกรมประมวลผลภาษาธรรมชาติ (NLP) ซึ่งเป็นสาเหตุหนึ่งที่อยู่เบื้องหลังประสิทธิภาพของ Google Assistant ในการทำความเข้าใจและประมวลผลคำพูดของมนุษย์

Google เพิ่งประกาศเปิดตัวใหม่สามตัว ใช้โมดูลหลายภาษา และจัดหาแบบจำลองหลายภาษาเพิ่มเติมสำหรับการดึงข้อความที่มีความหมายเหมือนกัน

โมดูลสองโมดูลแรกมีแบบจำลองหลายภาษาสำหรับการดึงข้อความที่มีความหมายคล้ายกันโดยโมดูลหนึ่งได้รับการปรับให้เหมาะสมสำหรับประสิทธิภาพในการดึงข้อมูลและอีกโมดูลสำหรับความเร็วและการใช้หน่วยความจำน้อยลง รุ่นที่สามมีไว้สำหรับ การดึงคำถาม - คำตอบ ในสิบหกภาษา (USE-QA) และแสดงถึงการประยุกต์ใช้ USE ใหม่ทั้งหมด โมดูลหลายภาษาทั้งสามได้รับการฝึกฝนโดยใช้ multi-task dual-encoder framework คล้ายกับรูปแบบ USE ดั้งเดิมสำหรับภาษาอังกฤษในขณะที่ใช้เทคนิคที่เราพัฒนาขึ้นเพื่อปรับปรุงไฟล์ ตัวเข้ารหัสแบบคู่พร้อมแนวทาง softmax ขอบเพิ่มเติม . พวกเขาได้รับการออกแบบมาเพื่อรักษาประสิทธิภาพการเรียนรู้การถ่ายโอนที่ดีเท่านั้น แต่ยังสามารถทำงานในการดึงความหมายได้ดีอีกด้วย

การประมวลผลภาษาในระบบมีมาอย่างยาวนานตั้งแต่การแยกโครงสร้างไวยากรณ์พื้นฐานไปจนถึงโมเดลการเชื่อมโยงเวกเตอร์ขนาดใหญ่ การทำความเข้าใจบริบทในข้อความเป็นปัญหาใหญ่อย่างหนึ่งในฟิลด์ NLP และ Universal Sentence Encoder แก้ปัญหานี้ได้โดยการแปลงข้อความในเวกเตอร์ที่มีมิติสูงซึ่งทำให้การจัดลำดับข้อความและการแสดงแทนง่ายขึ้น

ที่มาของโครงสร้างการทำเครื่องหมาย UTE - Google Blog

ตามที่ Google กล่าวว่า“ โมดูลใหม่ทั้งสามโมดูลนี้สร้างขึ้นจากสถาปัตยกรรมการค้นคืนความหมายซึ่งโดยทั่วไปจะแบ่งการเข้ารหัสคำถามและคำตอบออกเป็นเครือข่ายประสาทที่แยกจากกันซึ่งทำให้สามารถค้นหาคำตอบที่เป็นไปได้หลายพันล้านคำตอบภายในมิลลิวินาที ” กล่าวอีกนัยหนึ่งสิ่งนี้ช่วยในการจัดทำดัชนีข้อมูลได้ดีขึ้น

' โมดูลหลายภาษาทั้งสามได้รับการฝึกฝนโดยใช้ multi-task dual-encoder framework คล้ายกับรูปแบบ USE ดั้งเดิมสำหรับภาษาอังกฤษในขณะที่ใช้เทคนิคที่เราพัฒนาขึ้นเพื่อปรับปรุงไฟล์ ตัวเข้ารหัสแบบคู่พร้อมแนวทาง softmax ขอบเพิ่มเติม . พวกเขาได้รับการออกแบบมาเพื่อรักษาประสิทธิภาพการเรียนรู้การถ่ายโอนที่ดีเท่านั้น แต่ยังสามารถทำงานในการดึงความหมายได้ดีอีกด้วย .” ฟังก์ชัน Softmax มักใช้เพื่อประหยัดพลังงานในการคำนวณโดยการยกกำลังเวกเตอร์แล้วหารทุกองค์ประกอบด้วยผลรวมของเลขชี้กำลัง

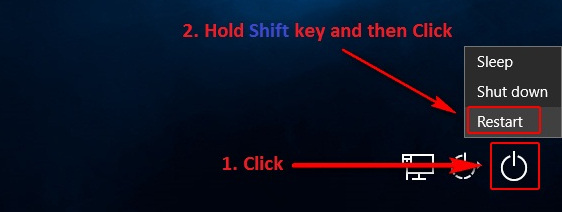

สถาปัตยกรรมการดึงความหมาย

“ โมดูลใหม่ทั้งสามโมดูลนี้สร้างขึ้นจากสถาปัตยกรรมการดึงข้อมูลเชิงความหมายซึ่งโดยทั่วไปจะแบ่งการเข้ารหัสคำถามและคำตอบออกเป็นเครือข่ายประสาทที่แยกจากกันซึ่งทำให้สามารถค้นหาคำตอบที่เป็นไปได้หลายพันล้านคำตอบภายในมิลลิวินาที กุญแจสำคัญในการใช้ตัวเข้ารหัสคู่เพื่อการดึงข้อมูลเชิงความหมายที่มีประสิทธิภาพคือการเข้ารหัสคำตอบของผู้สมัครทั้งหมดไว้ล่วงหน้าสำหรับการสืบค้นข้อมูลอินพุตที่คาดไว้และจัดเก็บไว้ในฐานข้อมูลเวกเตอร์ที่ได้รับการปรับให้เหมาะสมสำหรับการแก้ ปัญหาเพื่อนบ้านที่ใกล้ที่สุด ซึ่งช่วยให้สามารถค้นหาผู้สมัครจำนวนมากได้อย่างรวดเร็วด้วยผลดี ความแม่นยำและความจำ .”

คุณสามารถดาวน์โหลดโมดูลเหล่านี้ได้จาก TensorFlow Hub สำหรับการอ่านเพิ่มเติมโปรดดู GoogleAI ฉบับเต็ม โพสต์บล็อก .

แท็ก google